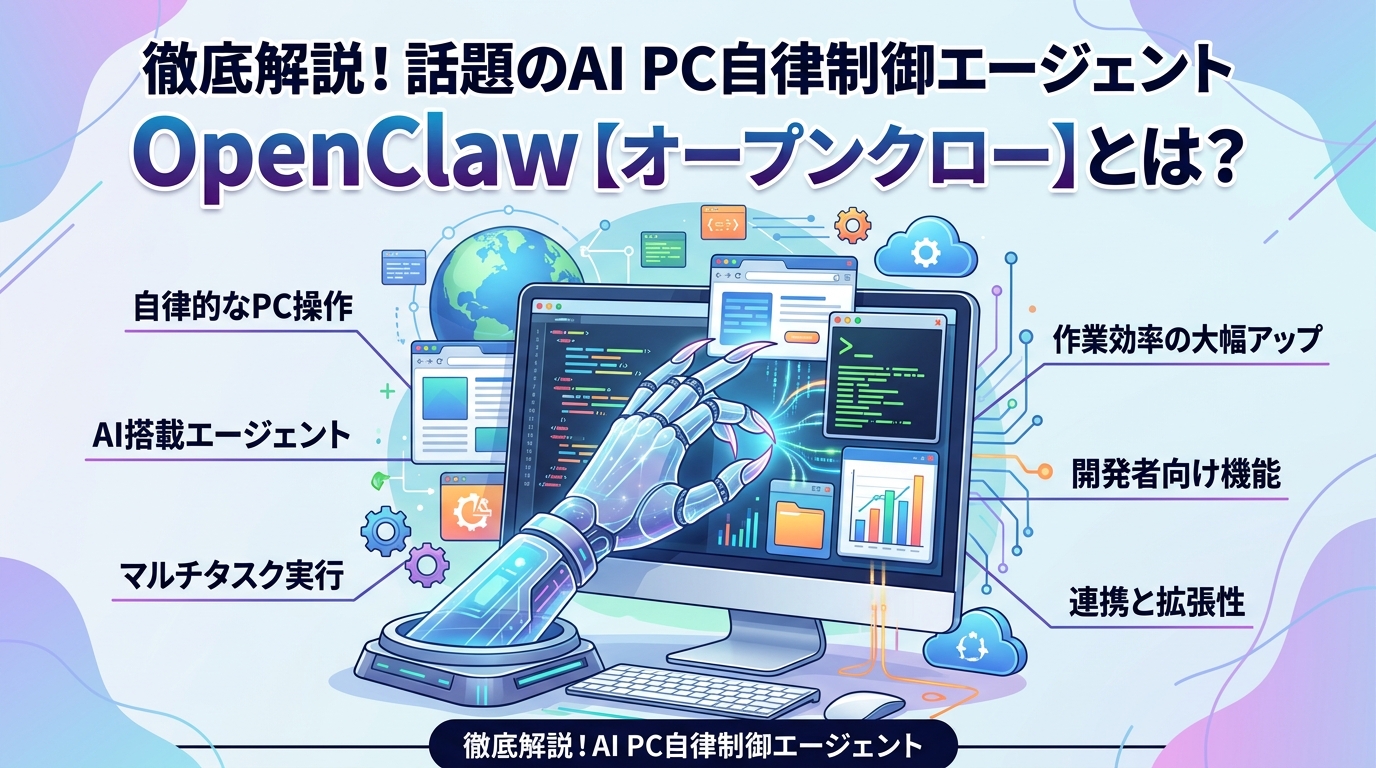

GitHubのスター数が27万を超え、あのReactをも上回るスピードで注目を集めているオープンソースプロジェクトがあります。 その名も「OpenClaw(オープンクロー)」。

「AIエージェント」という言葉はよく聞くけれど、実際に何ができるのか、どんなリスクがあるのか、よくわからないまま時間が過ぎている方も多いのではないでしょうか。

この記事では、OpenClawの概要・できること・セキュリティリスク・今後の展望を整理しました。

ぜひ最後までご覧ください。

OpenClawとは何か

手元のマシンで動くオープンソースのAIエージェント

OpenClawは、自分のパソコン上で自律的に動作するAIエージェントです。

AIそのものがパソコンに内蔵されているわけではありません。 外部のAI(OpenAIやAnthropicのAPIなど)、あるいはローカルで動作するLLMと連携しながら、パソコン上でさまざまな作業を実行します。

操作の入口になるのは、SlackやLINE、Discord、Telegramといったメッセージングアプリ。 遠くにある自分のマシンへ指示を送ると、AIが作業を実行して結果を返してくれる仕組みですね。

なぜこれほど話題になっているのか

2026年3月7日時点でのGitHubスター数は27万超。 これはあのReactを上回る数値であり、GitHub史上でも最速クラスのペースで注目を集めているプロジェクトです。

開発者はどんな人?

OpenClawを作ったのは、Peter Steinberger(ピーター・シュタインベルガー)さん。 オーストラリア・ウィーン出身のエンジニアで、PDFフレームワーク「PSPDFKit」を創業し、ベンチャーキャピタルから一切の資金調達なしで約10億人が使うプロダクトに育て上げた実力者です。

2026年2月14日には、OpenAIへの参加が正式に発表されました。 Xでの発言などから、Sam AltmanがOpenAIの将来製品にOpenClaw的な機能を組み込む意向を持っているとも見られています。

なお、OpenClaw自体のプロジェクトは継続予定とのことです。

名前の変遷と由来

| 時期 | 名前 |

|---|---|

| 当初 | ClaudeBot(クロードボット) |

| 2026年1月27日 | MoltBot(モルトボット) |

| 3日後 | OpenClaw(オープンクロー) |

最初の名前「ClaudeBot」はAnthropicからクレームが入り改名。 「Claw」はカニやエビの爪(ハサミ)を指す英語で、ロブスターがプロジェクトのアイコンになっています。

OpenClawで何ができるのか

AIが「聞かれた時だけ動く」を超える

従来のAIチャットは、質問すれば答える、という受け身のスタイルでした。 OpenClawは違います。 自律的に、継続的に仕事をし続けることが前提の設計です。

ハートビート機能:定期実行の仕組み

OpenClawの特徴的な機能のひとつが「ハートビート」です。

エンジニア的に言えばcronに相当するもの。 一定間隔でAIが自動起動し、そのときの状況に合わせてタスクをこなし続けます。

チャットGPTやAnthropicのCoworkにも類似機能はありますが、OpenClawではこれをより柔軟に設定できます。

スキルズとClawHub:能力を拡張する仕組み

OpenClawには「スキルズ」と呼ばれる拡張機能の仕組みがあります。 各スキルの中に手順・注意点・スクリプトなどが定義されており、AIにさまざまな能力を追加できます。

スキルを公開・共有するマーケットプレイスが「ClawHub」です。 ただし、後述するようにClawHubにはセキュリティ上の問題も指摘されています。

実際に試してみると

Raspberry Pi(ラズベリーパイ)にOpenClawをセットアップし、Slack連携を実装して動作を確認しました。

Slackに「今日の打ち合わせの議事録をもとにスケジュール調整して」と送ると、AIがカレンダーを確認して自動でスケジュールを入れてくれたとのこと。 こうした業務自動化は、実際に体験するとかなり便利に感じますね。

なぜMac miniが相性いいのか

OpenClawをローカルLLMで動かす場合、APIコストがかからず電気代のみで済むため経済的です。 16GBのUnified Memoryを持つMac miniは、20億パラメータ前後のオープンソースモデルを動かすのにちょうどよく、在庫切れが続くほど注目されています。

セキュリティリスクの実態

なぜ危ないのか

OpenClawはAIにPCへの強い権限を与えます。 人間がパソコンでできることは、原則としてAIでもできてしまう状態になるわけです。

具体的に想定されるリスクはこのとおりです。

| リスクの種類 | 内容 |

|---|---|

| 情報流出 | 知らない間にファイルの内容が外部へ送信される |

| ファイル削除 | 意図せずデータが消去される |

| リモート実行 | 悪意ある命令をリモートから送りつけて実行させる脆弱性 |

| インターネット露出 | デフォルト設定のミスで外部からマシンにアクセス可能になる |

ClawHubにも潜む脆弱性

あるセキュリティ企業がClawHubの約4,000ファイルをスキャンしたところ、283個(全体の約7%)にAPIキーやパスワードを露出させる脆弱性が見つかりました。 人気スキルであっても例外ではなかったとのことです。

現在は自動スキャンの仕組みが導入されつつありますが、改善途上の段階です。

使うなら自己責任で

特に、重要なファイルや認証情報が入ったマシンでの利用は避けるべきでしょう。

今後の展望

「去年のコーディングエージェント」に似ている

2025年1月頃に話題になったコーディングエージェント(Cline / Roo Clineなど)への興奮と同じ感覚です。

当時は「すごいけど現実的じゃない」と感じたものが、1年後の2026年にはClaude CodeやGemini CLI、ChatGPT Codexとして当たり前に使われるようになっています。 OpenClawも同じスピードで普及する可能性は十分にあります。

AIエージェントの進化には2つの方向がある

| 方向性 | 内容 |

|---|---|

| 人間と同じUI・PCを使わせる | ブラウザやGUIをAIが操作する(OpenClaw型) |

| AIが使いやすい環境を作る | Google Workspace CLIのようなAIファースト設計 |

短期的(1〜2年)には前者が主流になりそうです。 レガシーシステムが多い現実を考えると、AIエージェント向けに設計し直すより、人間と同じUIからアクセスさせる方が現実的だというわけですね。

まとめ

OpenClawについて整理すると、以下のようになります。

| 項目 | 内容 |

|---|---|

| 正体 | 手元のPCで動くオープンソースのAIエージェント |

| 特徴 | ハートビートによる定期実行、スキルズによる機能拡張 |

| 対応LLM | OpenAI / Anthropic / ローカルLLMなど |

| 現状の課題 | セキュリティリスク、ClawHubの脆弱性 |

| 今後 | 1〜2年で当たり前のツールになる可能性 |

現時点では本番環境への導入は推奨できません。 ただ、AIエージェントがどういう方向に進化するかを把握しておく意味で、動向を追っておく価値は高いツールです。

最後までご覧いただき、ありがとうございます。